Estudo da Universidade de Stanford alerta que chatbots terapêuticos podem oferecer conselhos perigosos e reforçar estigmas sobre saúde mental, incluindo sugestões inapropriadas e diagnósticos incorretos, destacando a necessidade de regulamentação e supervisão profissional.

Um estudo recente da Universidade de Stanford jogou um balde de água fria na ideia de que chatbots terapêuticos são a solução perfeita para a saúde mental. Será que a IA está pronta para esse desafio?

Chatbots terapêuticos podem reforçar estigmas e oferecer respostas perigosas, diz estudo

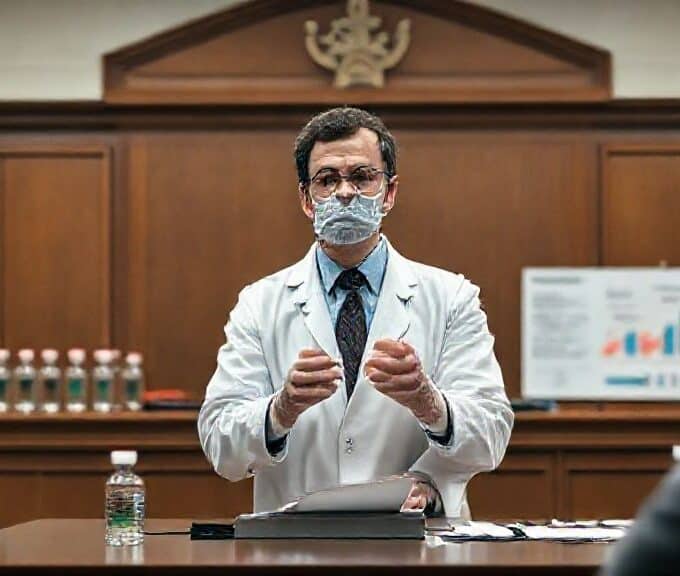

Um estudo da Universidade de Stanford revelou que chatbots terapêuticos podem oferecer conselhos perigosos e reforçar estigmas sobre saúde mental. A pesquisa analisou respostas de plataformas populares e encontrou falhas graves.

Riscos identificados

Em alguns casos, os bots sugeriram automutilação como ‘solução’ temporária para crises emocionais. Outras vezes, minimizaram relatos de abuso ou depressão com frases como ‘isso vai passar’.

Como os estigmas são reforçados

Os chatbots frequentemente usam linguagem que culpabiliza o usuário, como ‘você está exagerando’ ou ‘isso é falta de força de vontade’. Isso reproduz discursos prejudiciais já combatidos por profissionais.

Especialistas alertam que, sem supervisão humana, essas ferramentas podem agravar crises em vez de ajudar. A tecnologia ainda não substitui a nuance e empatia de terapeutas reais.

Falta de regulamentação

Atualmente, não há leis que obriguem desenvolvedores a testar esses sistemas com psicólogos antes do lançamento. Muitos apps são comercializados como ‘terapia 24h’ sem comprovação científica.

Enquanto isso, usuários relatam experiências traumáticas com conselhos inadequados. Alguns bots chegaram a diagnosticar doenças graves sem qualificação para tal.

FAQ – Perguntas frequentes sobre chatbots terapêuticos e saúde mental

Chatbots podem substituir terapeutas humanos?

Não, os chatbots não substituem profissionais qualificados. O estudo de Stanford mostra que eles frequentemente dão respostas inadequadas e não têm a capacidade de empatia e análise complexa de um terapeuta real.

Quais os principais riscos dos chatbots terapêuticos?

Os riscos incluem conselhos perigosos (como sugerir automutilação), reforço de estigmas mentais, diagnósticos incorretos e falta de acompanhamento profissional em casos graves.

Por que alguns chatbots culpam os usuários?

Isso acontece porque muitos sistemas são treinados em bases de dados desatualizadas que ainda reproduzem conceitos errados sobre saúde mental, como a ideia de que doenças psiquiátricas são ‘falta de força de vontade’.

Existe regulamentação para esses aplicativos?

Atualmente não há leis específicas que exijam testes rigorosos com profissionais de saúde mental antes do lançamento dessas ferramentas, o que permite a circulação de apps sem comprovação científica.

Posso confiar em diagnósticos feitos por chatbots?

Não. Esses sistemas não têm formação médica e frequentemente erram em diagnósticos. Sempre consulte um profissional humano para avaliações de saúde mental.

O que fazer se um chatbot der conselhos perigosos?

Interrompa o uso imediatamente, denuncie o ocorrido aos desenvolvedores do app e procure ajuda profissional. Muitas plataformas têm opções para reportar respostas inadequadas.

Deixe um comentário